Geolocalización, cuarentena y cómo salir de este enredo – Parte 2

Un análisis acerca de la app CuidAR, aplicación de autoevaluación de síntomas de Covid-19 que presentó el Gobierno Nacional. ¿Hay formas de implementar esta herramienta sin caer en la violación de la privacidad de las personas?

Esta aplicación –CuidAR– que fue desarrollada en conjunto entre la Secretaría de Innovación Pública -siguiendo los requerimientos y necesidades del Ministerio de Salud-, el Ministerio de Ciencia y Tecnología de la Nación, la Fundación Sadosky, el Consejo Nacional de Investigaciones Científicas y Técnicas (CONICET), y la Cámara de la Industria Argentina del Software (Cessi), que nucleó a las empresas Hexacta, Globant, G&L Group, C&S, QServices, GestiónIT, Intive, Finnegans y Faraday, tiene una serie de vacíos que preocupan y mucho. Solicita datos personales (incluido el escaneo del DNI), domicilio, información familiar, etc., todo con carácter de declaración jurada y aclara que, de ingresar información falsa, “puede considerarse una contravención grave”.

No tenemos permitido saber cómo funciona, qué hará con nuestros datos, etc. Pero sí está claro que podrá ser controlado por la policía, quien podrá solicitar a las personas que demuestre que tiene la aplicación descargada y activa, y que está vinculada con el certificado de circulación.

A este contexto, se le suma que, en Buenos Aires, donde para acceder al servicio público de transporte se debe utilizar la tarjeta SUBE, se ha decretado que: “Con el objetivo de reservar el uso del transporte público al personal calificado como esencial, se habilitará la tarjeta SUBE únicamente para quienes presten servicios esenciales y estén exceptuados”. Esto deja en claro que el entrecruzamiento de bases de datos y el big data que ya se viene realizando será el nuevo escenario en materia de control social. ¿Qué significa una medida como ésta?: si una persona tiene una emergencia, por ejemplo, ir a un hospital, pero no es ni trabajadorx esencial ni está exceptuado, no podrá usar el transporte público, porque el método de pago vigente esa persona no lo tendrá habilitado. Si la persona es pobre y no tiene vehículo o dinero para un transporte privado, no es un problema del Estado, que ha dicho hasta el cansancio que el coronavirus no distingue clases sociales, pero hay que recordarle al Estado que sus políticas sí.

Segunda parte de la entrevista que Mucho Palo Noticias le realizó a René Montes del Partido Interdimensional Pirata para ahondar en este complicado tema de la aplicación CuidAR, que, más que apuntar a la salud pública, parece apuntar a ir camino a un exacerbado escenario de control social.

—¿Qué implica para las personas que el Estado tenga acceso a la información de geolocalización?

—Bueno, ahí está el punto: el Estado, en realidad, no necesita tener esa información para salir de la cuarentena de manera gradual. La información y el rastreo de contactos se puede hacer perfectamente sin tener la información particular de dónde estuvo cada persona y con quiénes estuvo. Uno puede tener la información esa a partir de que después se informa que dio positivo y, de todos modos, la aplicación podría perfectamente tener un modo de privacidad que uno puede activar, porque si quiere hacer reunirse o algo y activa el modo de privacidad y que eso quede como de privacidad, y quedará la responsabilidad de la persona cuando se sepa contagiada de decir okay, entonces, yo usé el modo privacidad, pero estuve en tal lado con tal persona y quiero avisarle porque es parte de mis afectos y la quiero cuidar. Bueno, el modo de privacidad la idea sería que no lo use uno para subirse al subte. Porque no estaría cuidando a todas las personas, entonces, lo que nos falta es más un tema de conocimiento sobre el tema como un valor de lo que implica el cuidarnos entre todos.

«¿Qué implica para las personas que el Estado tenga esta información de ubicación geográfica y de contactos entre personas, que es lo que destaca a la aplicación CuidAR? Es algo muy indeseable que la gente esté normalizando esto, porque es justamente como una gran implementación de lo que es un panóptico».

—Una situación de control que se naturaliza y que nos va a cambiar realmente de la forma de relacionarnos. Yo creo que todo esto de la crisis sanitaria que se represente y que se armó un poco también la vataola, con un correlato real que cierto, pero que, a la vez, tiene como un montón de cuestiones que son de conveniencia para las personas más poderosas.

Para el Estado, representa, sobre todo, una gran responsabilidad, que de ninguna manera puede llegar a tener no, o sea, imagínate, voz cualquier persona que te dice tengo para darte la información de todas estas personas y vos qué haces, ¿lo aceptas? Lo tendrías que pensar dos veces porque es una responsabilidad tenerlo ahí, cómo la vas a tener y demás. Y eso es algo que no se está teniendo en cuenta de parte del Estado y que las personas no logran ver realmente con la profundidad de la problemática: por un lado, porque falta la idiosincrasia y la problemática de privacidad, ahí está el paradigma y el generalizado que uno tiene de un montón de cosas que son parte de la vida cibernética, en donde la privacidad es como una palabra muy anticuada aparentemente, y bueno, con esto de la aplicación, creo que es como algo en lo que podemos ver un ejemplo concreto de hacia dónde podemos llegar a ir con toda esta ignorancia generalizada en relación a lo que representa la privacidad en tiempos digitales y la pérdida de ésta.

—¿Qué implicancias puede tener que los datos se alojen en Amazon y por qué el Estado argentino tomó una determinación así?

—Amazon -o cualquier servidor que sea de afuera como podría ser Microsoft o cualquier nube Alibaba, que es el gigante asiático de China también, o no, o un servidor local de infraestructura como el de los datos del Ministerio de Salud o algo por el estilo-, este es un gran punto, que antecede al coronavirus: que el gobierno o la República Argentina no tenga una soberanía sobre la infraestructura de sus propios datos. Como los datos de la Sube, por ejemplo, ¿dónde los están alojando? Es un gran punto y es muy complicado, porque uno, a priori, puede decir sí, la verdad es que está mal que esté afuera, porque la verdad está mal que esté afuera. Ahora, ¿es realmente mejor que estén adentro?

Primero, la posición de Partido Pirata es que los datos que se registran tienen que ser muy pocos y sólo los necesarios. Si no, no hay por qué registrar datos. Ya las conversaciones que se guardan, por ejemplo, ¿para qué se guardan eternamente conversaciones, por ejemplo, de Telegram, que dentro de 3 años sigue acá? Uno tiene que tener también una conciencia propia de eliminar la información y, con esto del coronavirus, de nuevo la información se va a estar guardando y va a estar durante mucho tiempo seguro porque, además, va a ser muy valiosa para ellos saber qué pasó durante la pandemia.

El tema del almacenamiento de datos es enorme, la información que acumula año a año la especie humana es impresionante y crece exponencialmente: uno ve hace 10 años y mira un número que dice no sé cuántos millones de terabytes y dice ¡wow!, y miras el año siguiente, y ve como crece exponencialmente. Es bestial, entonces, que los datos estén en un servidor que no es el nuestro. Significa, primero, que se lo estamos entregando a un capitalista, muy exitoso de otro país, porque hay tres o cuatro solamente que tienen ese nivel de infraestructura, que, además, los servidores tienen ubicación secreta. Se han filtrado imágenes de esos servidores en zonas desérticas, en medio de EE.UU., con muros y construcciones como de una cárcel de máxima seguridad, llena de seguridad, armada. Y, adentro, sólo hay computadoras con datos.

Amazon, que es de un gran capitalista y un gran imperialista, que, incluso, le guarda datos a la CIA. No es muy agradable saber que los datos van a ir a Amazon, pero es real que un servidor acá no va a tener la infraestructura de Amazon, eso está claro.

Tener la información acá tampoco es sinónimo de más seguro, más allá de que no hay un proveedor nacional a la altura de Amazon. El problema sigue siendo la acumulación de ciertos datos que no son necesarios para determinada finalidad, pero que pueden y van a ser utilizados con finalidades de control y persecución.

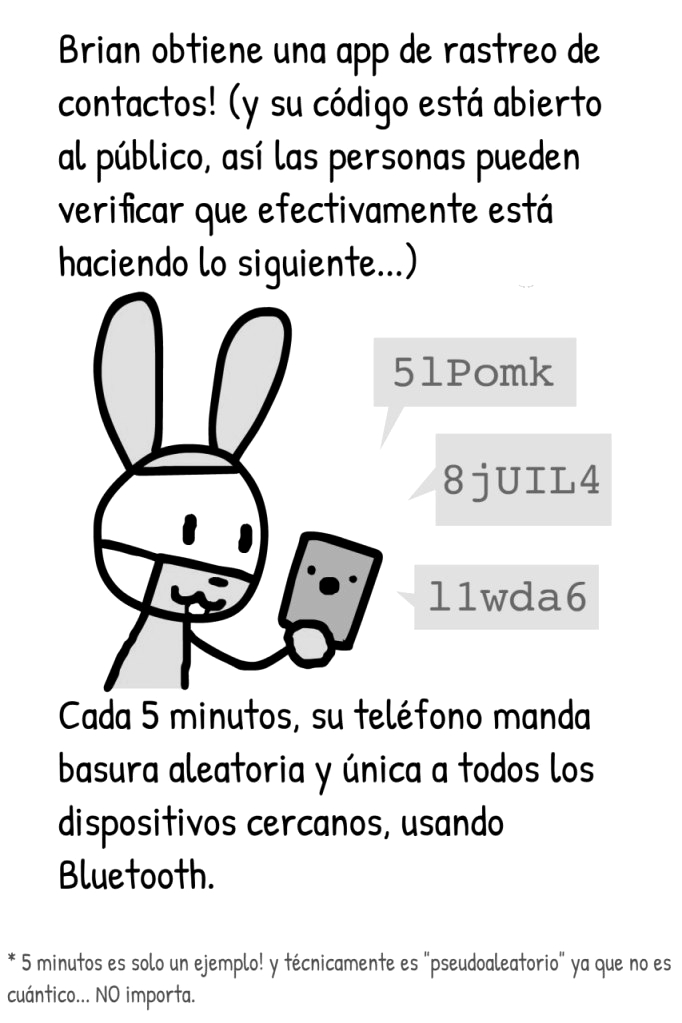

—¿En qué se diferencia que la aplicación como CuidAR tenga o no código abierto?

—El código abierto de la aplicación es muy importante porque nos da garantías a todos -aunque no todos podamos leer el código- porque sabemos que hay otras personas que sí lo pueden leer, y hay como un mínimo de garantía de transparencia en que alguien lee el código y garantiza, de alguna manera, que el código hace lo que se supone que hace y nada más.

En este caso, igual lo que se supone que hace es todo lo que nos preocupa que haga básicamente.

La preocupación viene más por lo que ellos van a estar usando de esa información porque nosotros podemos cederles la posibilidad de que hagan un rastreo de contactos para que podamos salir de la cuarentena de manera paulatina y recuperar un poco de nuestras vidas, poder salir y trabajar y demás. Eso sería algo que la aplicación con código cerrado podría también darnos, pero no se nos estaría dando la garantía si, además, están haciendo mayores abusos que los que el uso de la misma ya implica para la privacidad de una persona.

El solo uso de la aplicación así como está hoy que fuera de código abierto daría más garantías, pero, además, deberían, como se hace con otras aplicaciones de uso estatal, contratar a programadores para que lleven adelante una audiencia de seguridad, que todos puedan leer el código, tener acceso y que así se garantice que hace lo que dicen que hace y que lo hace bien. Ponerlo a prueba antes de usarlo, no sólo es cuestión de poder leer el código, es saber en qué partes se puede vulnerar como sistema, con el interés de los datos que va a contener.

Y además de pedir una audiencia de seguridad, hay que pedirle al Estado que después no persiga judicialmente a los hackers que, de manera altruista, auditan una aplicación, como pasó con la impresora de voto electrónico, donde hackers altruistas le hicieron la audiencia de seguridad de manera gratuita y, luego, fueron perseguidas por el Estado y terminaron con juicios y con un montón de desgaste. Cosas mínimas que el Estado debería otorgar al salir con una aplicación así, además de que el código sea abierto y que no te penen por controlar que funcione correctamente y demás.

—¿Cuál creen que puede ser el peor escenario posible con el uso de este tipo de aplicaciones?

—Que esto se naturalice es el peor escenario, porque hoy los datos se usan para este escenario, y después sea utilizado para perseguir a quienes se organizan y manifiestan por sus derechos. Una situación que ya sucede, con esta aplicación y que naturalicemos el uso de este tipo de métodos de control, donde no está claro para qué usarán los datos ni hasta cuándo y que, por ejemplo, en una manifestación, empiecen a cruzar las bases de datos, cosa que, como dije, ya se hace: eso que ya sucede ahora creo que la aplicación termina siendo como un gran hito dentro de esa manera de manejarse que pueden tener la policía y las fuerzas represivas del Estado, ahí creo que ese es el peor escenario.

Acá podés ver el cómic completo “Proteger la vida y la libertad” de Nicky Case

Leé la primera parte de la entrevista

*Por Mucho Palo Noticias.